【前提整理】この記事が扱う「AI」の範囲

「子どもにAIを使わせていいのか、正直よく分からない。」

そう思いながら、とりあえず様子を見ている。そんな保護者の方は少なくないのではないでしょうか。

あるいは学校の先生として、「AIをどう授業に取り入れればいいか」の答えが見つからないまま、時間だけが過ぎている。そんな状況かもしれませんね。

迷ってしまうのは当然かもしれません。AIという言葉は毎日耳にするのに、子どもへの具体的な向き合い方を教えてくれる場所がほとんどないように感じます。

ただ、一つだけお伝えしたいことがあります。

「様子を見る」という選択にも、実はリスクがあるのかもしれません。

この記事では、そのリスクも含めてお話ししてみたいと思います。そしてこの記事を読み終えたとき、「明日から前向きな気持ちでAIと向き合える」そう感じていただけたら、と願っています。

まず、少しだけ整理させていただけませんか。「AI」という言葉の範囲についてです。

- 文章を作るAI(チャットAI)

- 画像を作るAI

- 音声認識AI

- ロボットや自動運転

この中でも、今子どもたちが触れる機会が最も多いのがチャット型AI(生成AI)でしょう。具体的にはChatGPT・Gemini・Copilotなどですね。

この記事では、このチャット型AIに絞ってお話しを進めていきたいと思います。

ChatGPTは2022年11月の公開からわずか2ヶ月で月間アクティブユーザー1億人を突破しました(OpenAI社発表)。TikTokの9ヶ月、Instagramの2.5年を大きく上回るスピードです。

AIはもう、「一部の専門家だけが使うツール」という段階ではない、ということではないでしょうか。今この瞬間も、子どもたちの手が届く場所にあります。

小学生にAIは必要か?【2026年・私の考え】

私の考えからお伝えしますと、

必要だと感じています。

ただし、いくつかの条件がある、とも考えています。

「使い方を間違えてしまうと、かえって逆効果になってしまうかもしれません。」

実は、国も同じような方向性で考えているように感じます。

文部科学省は2023年7月、「初等中等教育段階における生成AIの利用に関する暫定的なガイドライン」を公表しました。

その内容は、とてもシンプルなものでした。

「全面禁止ではなく、正しく使うことを指導する」

つまり、禁止するのではなく、活用していくことが前提になっている、ということではないでしょうか。

この記事を読み終えたとき、「明日から前向きな気持ちでAIと向き合える」そう感じていただけたら、と願ってこの記事を書いています。

小学生がAIを使い始めるのに適した年齢は?私の見解

私の考えはシンプルです。

小学3〜4年生(8〜10歳)くらいが、一つの目安になるのではないでしょうか。

理由は2つあるように思います。

- 文章を読んで内容を理解できる

- 自分の考えを言葉にできる

この2つの力が育っていないと、AIはただ「答えを出してくれる便利な機械」になってしまうかもしれません。

NHK放送文化研究所の調査(2023年)によると、小学3年生以上でスマートフォンの利用率が急増するようです。

ちょうど情報リテラシー教育が必要になってくる時期と重なるように思います。

この時期から「情報を鵜呑みにせず、一度疑ってみる習慣」を身につけていくことが、AIを上手に活用していくための大切な土台になるのではないでしょうか。

低学年(1〜2年生)はどうすればいいか

もちろん、使ってはいけないというわけではありません。

ただし、必ず保護者の方が隣にいる状態で使うことが前提になるかと思います。

「一緒に読み、一緒に考える」という形であれば、きっと良い教育効果が期待できるのではないでしょうか。

なお、ChatGPT・Geminiともに公式の利用可能年齢は13歳以上です。

アカウント作成の際は、必ず保護者の方が管理されることをおすすめします。

小学生がAIを使う危険性・デメリット3つ

お子さんに使わせる前に、まずはリスクを正確に把握しておく必要があるのではないでしょうか。

① 思考放棄:考えない習慣がつく

私が最も懸念しているリスクが、まさにこれです。

AIに聞けば答えが出ます。 その便利さが、「考えなくてもいい」という習慣につながってしまうかもしれません。

調べ学習でAIに全部聞いて書き写すお子さんは、実際に増えていると聞きます。

読書感想文を丸写しするのと構造的には同じでしょう。 考える機会を、完全に奪ってしまうことにもなりかねません。

② ハルシネーション:AIの嘘を信じる

「ハルシネーション」と呼ばれる現象をご存知でしょうか。

AIが事実ではない情報を、もっともらしい自然な文章として生成してしまうことです。

総務省「情報通信白書 令和5年版」でも、生成AIが誤情報を出す可能性がある、と明記されていますね。

重要なのは、AIは「分かりません」とは言わない、という点です。

たとえ間違っていても、自信たっぷりに答えてしまうことがあります。

これは、私たち大人でも騙されてしまうことがあるほどです。

批判的思考力がまだ十分に育っていない小学生にとっては、特に注意が必要ではないでしょうか。

③ 個人情報・不適切コンテンツのリスク

AIチャットに入力した情報は、サービスによっては、学習データとして利用される場合がある、ということも知っておく必要があるかと思います。

お子さんが自分の名前や学校名、家族の情報を、無意識のうちに入力してしまうリスクも考えられます。

保護者の方による定期的な利用履歴の確認は、ぜひとも必要だと感じています。

小学生がAIを使うと思考力は下がる?データから考える

この点は、多くの保護者の方や先生方が気にされていることではないでしょうか。

本当に思考力は下がってしまうのでしょうか?

もう少しだけ、深く考えてみたいと思います。

データは何を示しているか

コロンビア大学の心理学者ベッチ・スパロウらの研究(2011年)があります。

「検索できる環境にある人は、情報そのものより情報の在処を覚える傾向がある」

これは、いわゆる「Google効果」と呼ばれている現象ですね。

さらに総務省「情報通信白書 令和5年版」では、デジタルメディアの過剰利用が情報を批判的に判断する力に影響を与える可能性もある、と明記されています。

ただし、ここで一つ、大切な前提があるように思います。

「どう使うか」で結果が真逆になる

OECDの学習到達度調査(PISA2022)でも、そのことが明確に示されているように感じます。

「ICTを学習ツールとして活用する場合」と「娯楽として過剰利用する場合」では、学習への影響が全く違ってくる、という結果が出ているようです。

つまり、こういうことではないでしょうか。

AIそのものが思考力を下げるのではありません。 「答えを得るためだけに使う習慣」がついてしまうと、思考力が下がってしまうかもしれません。

AIを「自分の仮説を検証するツール」として使うお子さんは、むしろ考える機会が増えていくように思います。

ここにこそ、大きな差が生まれてくるのではないでしょうか。

学校現場での小学生AI活用の現状【文科省の方針】

2023年以降、学校現場でのAI活用は急速に進んできているように感じます。

文部科学省の方針も、かなり明確になってきているようです。

- 禁止ではなく活用を前提とする

- 読書感想文・詩の創作などへのAI使用は慎重に

- 情報モラル教育・AIリテラシー教育を並行して実施する

つまり、学校がAIを排除する方向ではありません。 AIを排除するのではなく、「使い方を教えていく」という方向にシフトしている、ということではないでしょうか。

ここで一つ、私自身の経験からも、確認しておきたいことがあります。

2020年、小学校でプログラミング教育が必修化されました。

ただし、現場はどうだったか。

正直なところ、カリキュラムが十分に整わないまま、形式的な導入にとどまってしまった学校も少なくなかったのが実態ではないでしょうか。

そのまま時代はAIへと動いてしまいました。

プログラミングをしっかり学べないまま、次はAIの波が来ている。

先生方や教育委員会の皆さんが感じている、もどかしさは、まさにこの点にあるのかもしれません。

AIを使いこなすために、プログラミングが大切な理由

この話は、私がこの記事で最もお伝えしたいことの一つです。

「AIが進化したのだから、プログラミングは不要では?」

そう感じる方も少なくないのではないでしょうか。

実は私自身も、最初はそう思っていた一人です。しかし、実際にAIを使ってみて、その考えは大きく変わりました。

私自身が体験した「丸投げ」と「設計」の差

以前、ホームページの制作をAIにお願いしてみたことがあります。

最初は「ホームページを作って」と一言だけ伝えました。AIは確かに、何かを形にしてくれました。でも、出来上がってきたものは、私の意図とはかけ離れた、ごく一般的な内容だったのです。

次に、構成・ターゲット・伝えたいメッセージ・各セクションの役割を一つずつ整理してからAIに指示しました。すると、結果は全く別の、期待以上のものになりました。

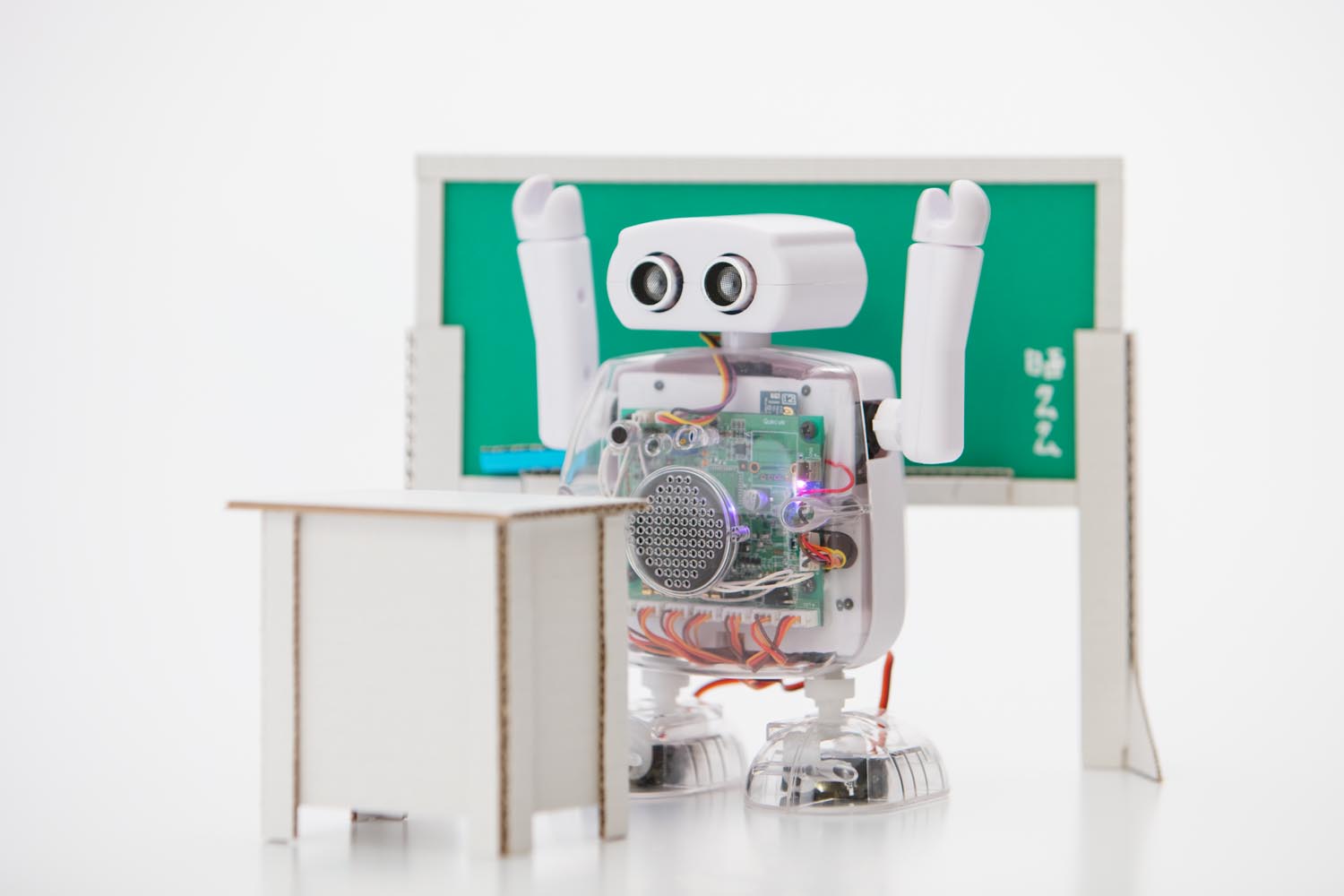

私たちが開発しているクムクムロボットでも、同じような経験をしました。

「歩かせて」と一言だけ指示したときと、「まず右足を前に出す、次に左足を前に出す、バランスを取るために腕を〜」と順番を細かく設計してから指示したときでは、ロボットの動きの精度が全然違ったのです。

これは、決して偶然ではないと感じています。

AIは「何をどう作るべきか」を、自分自身で考えることはできません。使う人間が「何を、どの順番で、どのレベルまで」と具体的に設計して初めて、AIは私たちの意図通りに動いてくれるのではないでしょうか。

そして、この「設計する力」こそが、まさにプログラミングで鍛えられる思考そのものだと、私は考えています。

プログラミングとは、コンピュータへの「正確な指示の連続」です。「何を、どの順番でやらせるか」を、自分で構造化していく訓練そのものなのです。だからこそ、プログラミングを学んだ人は、AIへの指示も自然と上手になっていくように感じます。

AIへの指示とプログラミングは同じ構造だ

AIに私たちが求めるような、質の高い答えを出させるためには、何が必要なのでしょうか。

- どれだけ正確な質問ができるか

- どれだけ細かく、緻密な指示を出せるか

- 結果を見て、どこが違うかを判断できるか

これは、プログラミングを学ぶ中で培われる思考と、全く同じ構造をしていると感じます。

逆に言えば、プログラミングを学ばずにAIだけ使っても、「AIに丸投げして、期待外れな結果が出てくる」という体験を繰り返してしまうだけになってしまうかもしれません。

AIが登場し、普及が進む今だからこそ、プログラミングを学ぶ必要性は、むしろ高まっているのではないかと私は考えています。

小学生へのAIの正しい使い方【保護者向け4ステップ】

では、具体的にどのようにAIとお子さんが向き合っていけば良いのでしょうか。

私の考える答えは、とてもシンプルです。

Step1:まず子どもに考えさせる

AIを使う前に「自分はどう思う?」と必ず聞いてみてください。

答えられなくてもいいのです。「分からない」でも構いません。

「自分で考えようとした」という行為そのものが、とても大切だと感じています。

Step2:一緒にAIに質問する

最初は、お子さん一人だけに使わせるのではなく、

保護者の方が隣で、一緒にプロンプト(質問文)を作ってみてはいかがでしょうか。

「どう質問すれば、より良い答えが引き出せるか」を考える過程そのものが、お子さんにとっての大きな学びになるはずです。

Step3:「本当にそう?」と疑わせる

AIの答えが返ってきたら、すぐに問いかけてみましょう。

「これ、本当に正しいことだと思う?」

ハルシネーションの存在を教えながら、情報を鵜呑みにせず、一度疑ってみる習慣を育てていくことが大切です。

Step4:自分の言葉でまとめさせる

最終的には、「AIが言ったことについて、自分はどう思うのか?」ということを、お子さん自身の言葉でまとめさせてみてはいかがでしょうか。

ここで初めてAIは「単に答えを出してくれる機械」から、「お子さんの思考を深める相手」へと変わっていくのだと思います。

大切なポイントは一つです。AIの答えを、常に「絶対的な正解」としないこと。

小学生のAI利用でやってはいけないNG行動

NG行動も、とてもシンプルです。以下の3つを避けていただくだけで、大きなリスクのほとんどは防げるのではないかと思います。

NG①:「AIに聞けば?」と丸投げする

子どもが何か調べたいとき、「AIで調べな」と任せっきりにするのが、最も避けるべきパターンかもしれません。

これは、「考えなくてもいい」という許可を与えてしまうことと同じになってしまうかもしれません。

必ず一緒に使うこと。この一点だけでも、大きく変わるはずです。

NG②:AIの答えをそのまま宿題に使わせる

読書感想文・自由研究・作文をAIに丸投げして提出させることは、お子さんの思考力の発達を阻害するだけではなく、

文部科学省のガイドラインにも、反することになってしまうかもしれません。

最終的なアウトプットは、必ずお子さん自身の言葉で仕上げることが、大切な原則だと考えます。

NG③:利用履歴を確認しない

どんなことをAIに聞いているか、保護者の方は、定期的に確認することが必要ではないでしょうか。

個人情報の入力や不適切な質問などを、もしもの場合も、早期に発見できるはずです。

例えば「月に1回、一緒に利用履歴を見直す」といった仕組みを作ってみるのも良いかもしれませんね。

現場で感じた、AIが変えるチームの可能性

ここからは、私自身の現場での経験をお話しさせてください。

私が経営する株式会社キヤミーで、プログラマーやシステムエンジニアと仕事をしています。

私たちの仕事はお客様のシステム開発が中心です。そして、私たちの仕事のほとんどの現場では、お客様から「AIを使ってもいい」という許可が出ない限り、AIを使うことはできません。これが、今の開発現場のリアルな状況でもあります。

ところが先日、たまたま新しいお客様との案件で、こちらが提案するシステムにAIを試験的に導入できる機会がありました。

結果は、私の想像をはるかに超えるものでした。

何が変わったか

特に変化が大きかったのは、これまでテストの品質がなかなか安定しなかったエンジニアたちでした。

テスト仕様書の作成をAIに補助させたところ、驚くほど抜け漏れが減り、テストの品質が明らかに向上したのです。コードのレビューもAIに確認させることで、これまで見落としがちだった問題点も、早い段階で見つかるようになりました。

「品質が安定しない」と悩んでいたエンジニアが、AIというツールの力を借りることで、確実に成長できた姿を目の当たりにしました。これは、私にとって大きな発見でした。

ただし、ここが重要です

ただし、AIが仕事を「すべてやってくれた」わけではありません。

テスト仕様書をAIに出させるためには、「何をテストすべきか」を自分で理解していなければなりません。コードをAIに確認させるためには、「どこを見てほしいか」を正確に指示できなければなりません。

つまり、AIに正しい仕事をさせるためには、使う人間の思考力が、やはり土台として必要不可欠だと感じています。

この構造は、プログラミングを学ぶことと、全く同じだと私は考えています。

考える人は、AIを自分の力に変えて使いこなしていく。

考えない人は、AIに言われるがままに使われてしまう。

この構造は、きっとお子さんたちの世界でも、同じように起きてくるのではないでしょうか。

よくある質問(FAQ)

Q1. 小学生がAIを使い始めるのに適した年齢は何歳ですか?

目安は小学3〜4年生(8〜10歳)です。

文章を読んで理解でき、自分の考えを言葉にできる段階が前提です。 それ以前に使う場合は、必ず保護者と一緒に使うことが重要だと考えます。

ChatGPT・Geminiの公式な利用可能年齢は13歳以上です。

Q2. 小学生がChatGPTを使うのは危険ですか?

使い方によっては危険かもしれません。

答えを丸写しにする習慣がつくと思考力の低下につながる可能性があります。 ハルシネーション(誤情報の生成)があるため、答えを疑う姿勢を必ず持たせてください。

保護者の管理のもと、正しい手順で使えば問題はないのではないでしょうか。

Q3. 宿題にAIを使ってもいいですか?

課題の種類によるかと思います。

「情報収集」や「アイデア出し」には使えるかもしれません。

読書感想文・作文・自由研究など「自分の考えを表現する課題」へのAI使用は、文部科学省のガイドラインでも慎重にと明記されています。

最終的なアウトプットは必ず自分の言葉で仕上げることが原則だと考えます。

Q4. AIが進化したのにプログラミングはまだ必要ですか?

むしろ今こそ必要だと私は考えます。

AIに正確な答えを出させるには、正確で緻密な指示(プロンプト)を作る力が必要です。

この思考はプログラミングで鍛えられます。 プログラミングを学んだ子どもは、AIをより深く、正確に使いこなせるようになるでしょう。

Q5. 学校の先生がAIを授業に取り入れるには何から始めればいいですか?

まず文部科学省のガイドライン(2023年7月)を確認してみてはいかがでしょうか。

「禁止ではなく正しく使う指導」が国の方針です。

授業への導入は、調べ学習での情報収集補助から始めるのが現実的かもしれません。

同時に、AIを正しく使う土台としてプログラミング的思考の教育を体系的に組み込むことを推奨します。

Q6. 小学生向けにおすすめのAIの使い始め方はありますか?

まず「一緒に使う」から始めてみてください。

保護者や先生が隣にいる状態で、「どう質問するか」を一緒に考えることが最初の一歩になるはずです。

AIへの指示の出し方(プロンプト)を工夫する体験は、そのままプログラミング的思考のトレーニングになるのではないでしょうか。

「お題をください」——私が感じた、子どもたちの違和感

私たちが運営するクムクムの教室で、こんな場面に出くわしたことがあります。

ロボットを子どもたちの前に置いて、こう伝えました。

「これから20分間、自由にこのロボットを動かしてみてください。」

すると、ほとんどすべての子どもたちが、口を揃えてこう言ったのです。

「お題をください。」

「どんなお題でもいいです。」

「まっすぐ歩くクムクムでも、バタバタするクムクムでも。」

お題さえあれば動ける。しかし、お題がなければ、何を始めていいか分からない。

これは、決して特別な子どもたちの話ではない、と感じています。今の時代を生きる多くの子どもたちに、共通して見られる傾向なのではないでしょうか。

言われたことは、きちんとできる。でも、自分で問いを立てることが、なかなか難しい。

この光景を目の当たりにしたとき、私は正直、少し怖さを感じました。

なぜなら、AIへの指示も、プログラミングも、そしてどんな仕事も、すべて「自分で問いを立てる」ことから始まるものだからです。

お題を待ち続けるだけのお子さんは、たとえAIという強力な道具を与えられても、なかなか使いこなせないかもしれません。AIに「何でもやって」と丸投げするだけで、終わってしまう可能性もあるでしょう。

逆に、自分で問いを立てられるお子さんは、AIをあくまで自分のための道具として、上手に使いこなしていくはずです。「こういう動きをさせたい。そのためには、AIにどう指示すれば良いだろうか」と、自分で考えられるようになるからです。

この差は、すでに今この瞬間から、静かに始まっているように感じています。

このまま「様子見」を続けるとどうなるか、私の懸念

決して不安を煽りたいわけではありません。ただ、現実として、皆さんにお伝えしておきたいことがあります。

「様子を見る」という選択は、残念ながら、実質的には「何もしない」ことと同じになってしまうかもしれません。

「お題をください」と言い続けるお子さんが、もしそのまま大人になったとき、何が起きるでしょうか。

AIに的確な指示を出せない。プログラムを自分で設計できない。そして、自分で仕事を作り出すことができない。

派手に失敗するわけではないかもしれません。ただ、静かに、そして気づかないうちに、大きな差がついていってしまうのではないでしょうか。

2020年にプログラミング教育が必修化されました。しかし十分に定着しないまま、AIの時代が来てしまいました。そして今、また同じことが繰り返されようとしているように感じています。「とりあえず様子を見る」という判断が、静かに、しかし確実に、子どもたちの未来の選択肢を狭めていってしまうのではないかと懸念しています。

もし「AIは怖いから使わせない」という判断を続けてしまった場合、お子さんは2つの大きなリスクを負うことになるかもしれません。

ひとつは「AI活用の遅れ」です。学校教育の現場は、すでに急速にAIを取り込む方向に動き出しています。使い方を知らないお子さんは、授業の中で取り残されてしまう可能性も出てくるかもしれません。

もうひとつは「より危険な使い方をする」リスクです。親御さんの目の届かない場所で、友達から教わって、誤った使い方を覚えてしまうかもしれません。管理できていない状態で使われる方が、はるかに大きなリスクを伴うのではないでしょうか。

今、私たちに必要なのは、全面的な禁止でも、ただ様子を見るだけでもないと私は考えます。

「自分で問いを立てる力」を育てながら、AIとプログラミングを体系的に学ばせていくこと。それが、今最も大切なことではないでしょうか。

まとめ:小学生とAIの正しい向き合い方、私からの提案

小学生にAIは必要でしょうか。

私の答えは、とてもシンプルです。

必要だと考えます。ただし、使い方次第で、その影響は大きく変わってくるでしょう。

- 「答えを出す機械」として使う → 思考力を下げる可能性がある

- 「考えを深める道具」として使う → 思考力を育てる

そして、AIを「考えを深める道具」として使いこなすために、最も有効な土台となるのが、プログラミング教育だと私は確信しています。

AIへの指示とプログラミングは、実は同じ思考構造を持っているのです。 今こそ、改めて子どもたちにプログラミングをマスターさせていくべき理由が、ここにあるのではないでしょうか。

まずは今日、一つだけ試してみてはいかがでしょうか。

お子さんが何か調べたいと言ったとき、すぐにAIに聞かせる前に「自分はどう思う?」と、まずお子さんの考えを聞いてみてください。

たったこれだけでも、大きな一歩になるはずです。

AIは道具です。 使う人間の思考力こそが、AIの真の価値を決めるのだと、私は考えています。

ここまで読んで、少し焦りを感じた方もいらっしゃるかもしれませんね。それは、とても大切な感覚だと思います。ただ、焦りすぎる必要はありません。今日から一つずつ、できることから始めていけば、きっと間に合うはずです。

もしロボットを使ったプログラミング教育に興味をお持ちでしたら、私たちが開発した「クムクム(Qumcum)」を一度のぞいてみてはいかがでしょうか。

京都生まれの純国産ロボット教材で、スクラッチからPythonまで、小学生から本格的なプログラミング思考を育てることができます。

京都大学の授業採用や京都市教育委員会との8年間の実績をもとに、先生方や学校向けのカリキュラムもご用意しています。

→ クムクムについて詳しく見る(https://qumcum.com)